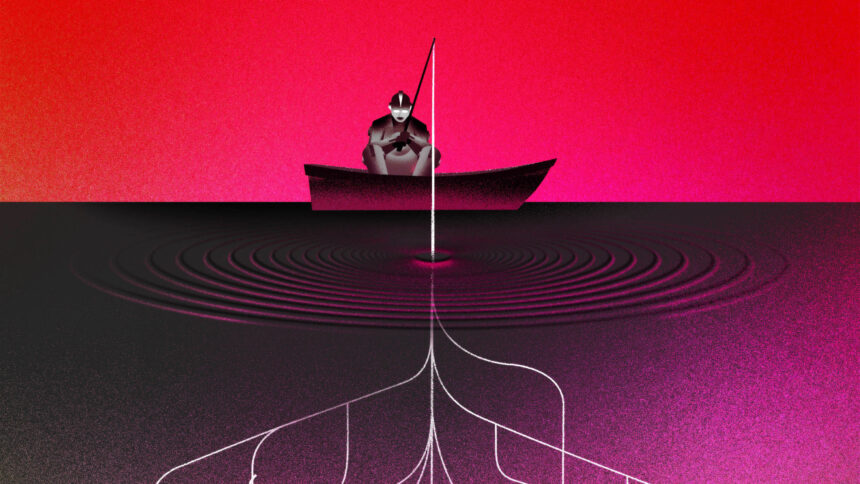

Yapayzeka, dolandırıcılık operasyonlarını hızlandırıyor ve deepfake’lerle kimlik sahtekarlığını kolaylaştırıyor. Açık kaynak ve ajan tabanlı asistanlar, kullanıcı verilerini riske atma ihtimali nedeniyle güvenlik uzmanlarını alarma geçirdi.

Yapayzeka artık yalnızca yazılım geliştiricilerin işini kolaylaştırmıyor; aynı araçlar siber suçlular tarafından da benzer biçimde kullanılıyor. Büyük dil modelleri ve derin üretim teknolojileri, dolandırıcıların kimlik taklidi ve sosyal mühendislik saldırılarını daha hızlı ve daha ölçekli hâle getirmesini sağlıyor.

Yapayzeka ve ajan asistanlarının riskleri

Özellikle son haftalarda gündeme gelen OpenClaw gibi projeler, kullanıcıların kendilerine özgü AI asistanları kurmasına izin veriyor. Bazı kullanıcılar bu tür sistemlere yılları kapsayan e-posta arşivleri ya da cihaz içeriklerini yükleyebiliyor; güvenlik araştırmacıları bunun çok daha büyük saldırı yüzeyleri ve veri sızıntısı riskleri yaratabileceği konusunda uyarıyor. OpenClaw’in geliştiricisinin, teknik olmayan kullanıcıların yazılımı kullanmaması gerektiğini belirtmesi bu kaygıları doğruluyor.

Uzmanlar, şirketlerin ve geliştiricilerin bu tür ajanları güvenli hâle getirmek için yalnızca model doğruluğunu değil, ajanların dış dünyayla etkileşim yeteneklerini (ör. web tarayıcısı, e-posta, dosya erişimi) kısıtlayacak yeni güvenlik yaklaşımlarını benimsemeleri gerektiğini söylüyor. Bu, hata yapan veya kötü amaçlı yönlendirilen bir asistanın sınırlarını çizmek ve kullanıcı verilerini korumak için hayati önem taşıyor.

Bu tartışmanın eş zamanlı bir diğer boyutu da açık kaynak modellerin yükselişi. DeepSeek’in Ocak 2025’te yayımladığı R1 modelinden bu yana, Çinli firmaların ağırlıklarını (weights) paylaşarak erişimi ve değiştirmeyi mümkün kılan modelleri piyasaya sürmesi, yetenekleri daha ucuz ve erişilebilir kıldı. Açık kaynak modellerin büyümesi, hem demokratikleşme hem de kötüye kullanım açısından yeni dinamikler yaratıyor; güvenlik politikaları ve kullanım kısıtları bu ortamda daha da önem kazanacak.

Sonuç olarak, yapayzeka tabanlı asistanların popülerleşmesiyle birlikte teknik çözümler kadar düzenleyici ve kullanıcı odaklı önlemler de kritik olacak. Şirketler, güvenlik araştırmalarındaki tekniklerle birlikte kullanıcı eğitimine, veri minimizasyonuna ve ajan davranışını sınırlandıran tasarım ilkelerine yatırım yapmazsa riskler hızla artabilir.

Kaynaklar ve Bağlantılar:

- www.technologyreview.com/2026/02/12/1132386/ai-already-making-online-swindles-easier

- www.technologyreview.com/2026/02/11/1132768/is-a-secure-ai-assistant-possible

- www.technologyreview.com/2026/02/12/1132811/whats-next-for-chinese-open-source-ai

- www.reuters.com/business/pentagon-pushing-ai-companies-expand-classified-networks-sources-say-2026-02-12

- www.theguardian.com/technology/2026/feb/11/instagram-adam-mosseri-social-media-addiction-trial

Bir Cevap Bırakın