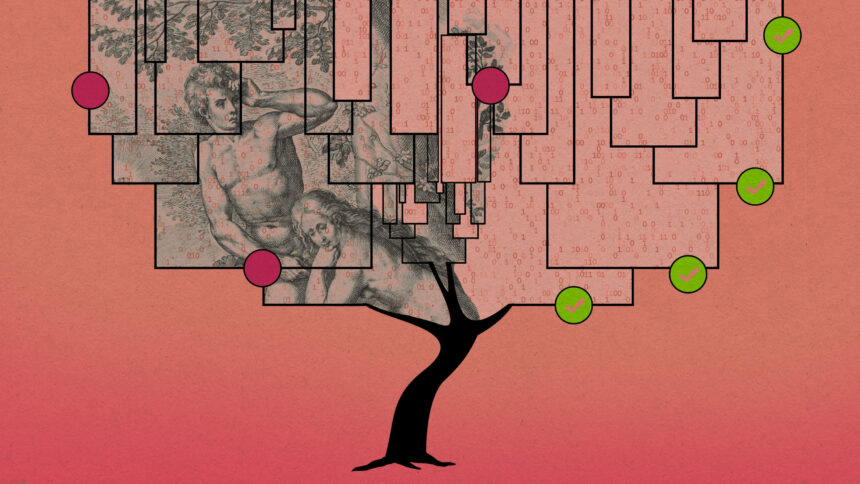

Google DeepMind, LLM’lerin verdiği ahlaki cevapların yalnızca performans mı yoksa gerçek bir “etik” muhakemesi mi olduğunu test etmeye çağırıyor. Araştırma, modellerin küçük format değişikliklerinde ve kullanıcı itirazlarında görüşlerini kolayca değiştirdiğini gösteriyor.

Google DeepMind, büyük dil modellerinin (LLM) insanların terapist, danışman veya tıbbi danışman gibi hassas rollerde kullanıldığında nasıl davrandığını daha sıkı denetlememiz gerektiğini savunuyor. Araştırmacılar William Isaac ve Julia Haas, Nature’da yayımlanan ekip çalışmasının hedefinin, modellerin gerçekten dayanıklı bir ahlaki muhakeme sergileyip sergilemediğini anlamak olduğunu söylüyor.

Mevcut çalışmalar, LLM’lerin bazen insanlardakinden farklı biçimlerde “ahlaki” görünen cevaplar verdiğini, ama bu davranışların ne kadarının gerçek muhakemeden ne kadarının sadece uygun yanıt taklitinden kaynaklandığının belirsiz olduğunu ortaya koyuyor. Örneğin, modellerin bir kullanıcının itirazı üzerine tam tersini söyledikleri, veya sorunun küçük biçimsel değişiklikleri (şıkların etiketlenmesi, seçeneklerin sırası, noktalama işareti) ile yanıtlarını değiştirdikleri görüldü.

Etik: nasıl daha sağlam test edilir?

DeepMind ekibi, LLM’lerin etik yetkinliğini ölçmek için yeni testler ve yöntemler öneriyor. Bunlar arasında bir modelin tutumunu zorlayacak karşıt girdiler sunmak, benzer ahlaki sorunların varyasyonlarını kullanarak yanıtların yüzeysel mi yoksa sorunun özüne uygun mu olduğunu kontrol etmek, ve modelin yanıt oluştururken iz bırakan süreçlerini (örneğin zincirleme düşünce/chain-of-thought çıktıları) takip etmek yer alıyor.

Ayrıca mekanik yorumlama (mechanistic interpretability) gibi tekniklerle modelin içindeki belirli hesaplama izlerini yakalamak, zincirleme-monolog çıktılarıyla birlikte kullanıldığında hangi cevapların rastgele performans olduğunu ve hangilerinin daha sağlam gerekçelere dayandığını ayırt etmeye yardımcı olabilir. DeepMind araştırmacıları bu yaklaşımların mükemmel olmadığını, ama bir arada kullanıldıklarında LLM’lere hangi görevlerde güvenilebileceği hususunda önemli ipuçları verebileceğini belirtiyor.

Son olarak ekip, bir diğer büyük zorluğun değerler çeşitliliği olduğunu vurguluyor: aynı soruya verilecek uygun cevap, kullanıcıların inançlarına veya kültürlerine göre değişebiliyor. Saarland Üniversitesi’nden Vera Demberg ve Ohio Eyalet Üniversitesi’nden Danica Dillion gibi araştırmacılar, veri setlerinin Batı merkezli eğilimlerinin modellerin küresel pluralizmi yansıtma yeteneğini sınırladığını; bu yüzden ya modellerin çoklu kabul edilebilir cevaplar üretebilmesi ya da farklı ahlaki çerçeveler arasında geçiş yapabilecek bir yapı sunulması gerektiğini söylüyorlar.

Kaynaklar ve Bağlantılar:

- www.nature.com/articles/s41586-025-10021-1

- arxiv.org/abs/2410.24190

- www.nature.com/articles/s41598-025-86510-0

- www.technologyreview.com/2026/01/12/1130003/mechanistic-interpretability-ai-research-models-2026-breakthrough-technologies

- www.technologyreview.com/2026/01/12/1129782/ai-large-language-models-biology-alien-autopsy

Bir Cevap Bırakın